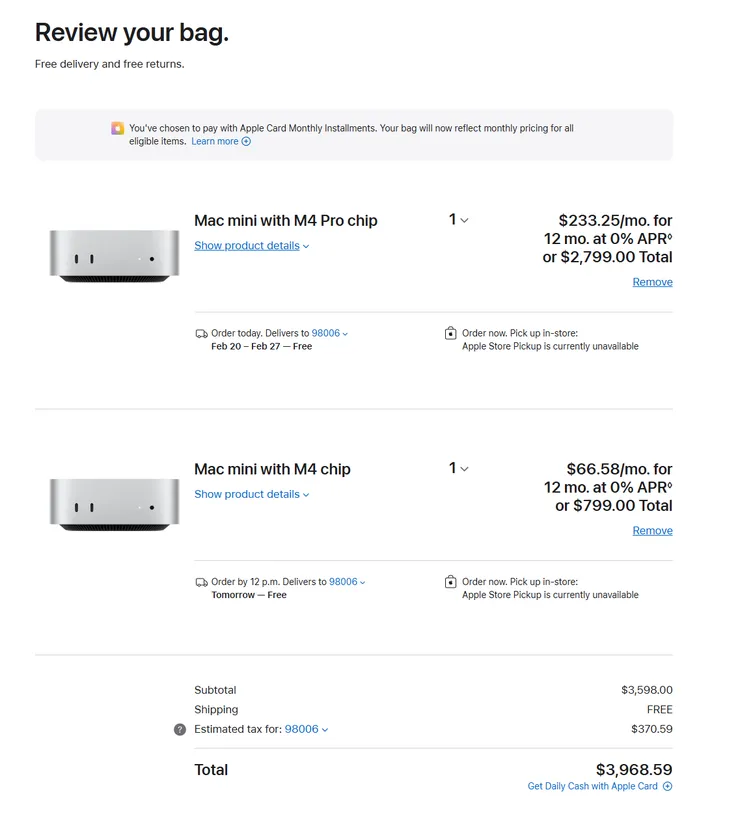

한대는 Open Claw용 한대는 로컬 LLM 돌리는 목적입니다.

이거 구성해서 가지고 놀면 한동안은 심심하지 않을까요 ?

---> 결론은 여러 감사한 댓글 덕택에 그냥 집에서 놀고 있는 DELL 노트북에 윈도우 깔아서 WSL기반으로 Open Claw 설치해보고 상용 AI API 기반으로 연결해서 우선 사용해보렵니다.

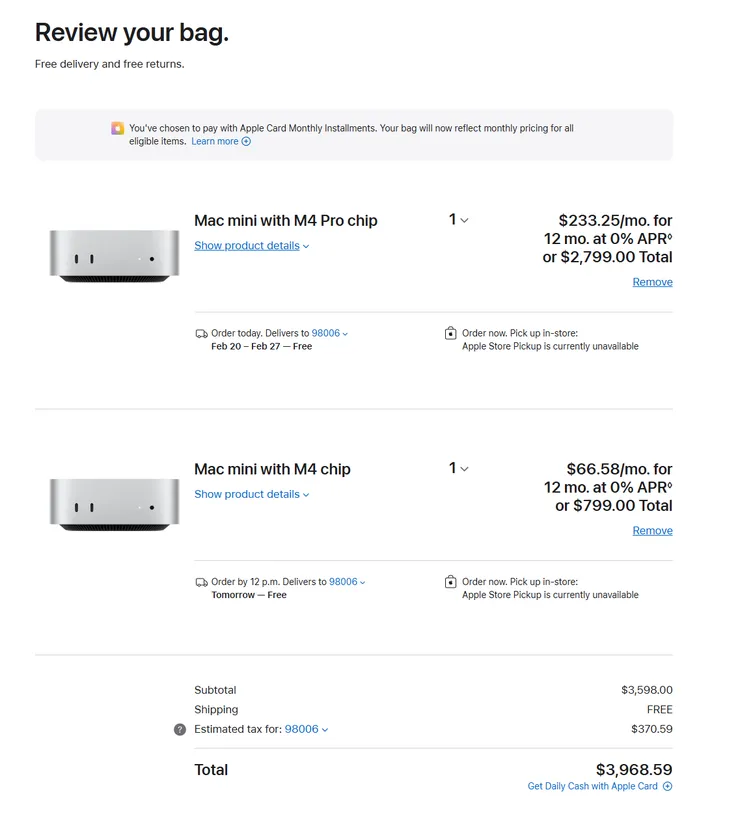

한대는 Open Claw용 한대는 로컬 LLM 돌리는 목적입니다.

이거 구성해서 가지고 놀면 한동안은 심심하지 않을까요 ?

---> 결론은 여러 감사한 댓글 덕택에 그냥 집에서 놀고 있는 DELL 노트북에 윈도우 깔아서 WSL기반으로 Open Claw 설치해보고 상용 AI API 기반으로 연결해서 우선 사용해보렵니다.

신천지총회장 이만희는 요한일서 4장 1절의 거짓 선지자 신천지총회장 이만희는 데살로니가후서 2장 3절의 멸망의 아들 신천지총회장 이만희는 베드로후서 2장 14절의 저주 받은 자식 신천지총회장 이만희는 잠언서 25장 14절의 비없는 구름 신천지총회장 이만희는 거짓목자, 영생 못함, 죄인이고 불못에 들어감

차라리 고사양 Mac Mini Pro 대신에 GB10을 살까요 ?

Mac Studio는 최고로 뽑으면 만딸라...ㄷㄷㄷ

LLM 생성속도 생각하면 답답하실것이라서요. GB10 LPDDR 대역폭이 낮아서요.

그렇다고 맥미니 일반형도 대역폭이 높은편은 아니라 로컬 LLM 빠르게 사용하실꺼면

그냥 3090 이 대세 였던거 같아요.

결국 로컬 LLM 은 그냥 장난감 수준이라 보시면 되요.

--- 상용 LLM 은 이미지, 텍스트, 음성 뭐를 줘도 1개의 api 에서 다 처리가 가능하지만 로컬 LLM 은 이미지, 텍스트 다 지원하는 멀티모달이 그렇게 많지 않아서 각각 구현해야 하고 그러다 보면 메모리 높은 고 사양으로 가야하는데 또 설정하려면 짜증만 나고 등등 많이 불편하실거라서요.

그리고 3900불로 5090 데스크탑 하나로 몰빵(?)하시는게 그나마 빠르지 않을까요..

(맘에 안들땐 되팔기도 가능할거 같고..)

메모리는 가장 많은 모델로 구매하세요.

> Local is doable, but OpenClaw expects large context + strong defenses against prompt injection. Small cards truncate context and leak safety. Aim high: ≥2 maxed-out Mac Studios or equivalent GPU rig (~$30k+). A single 24 GB GPU works only for lighter prompts with higher latency. Use the largest / full-size model variant you can run; aggressively quantized or “small” checkpoints raise prompt-injection risk (see Security).

https://docs.openclaw.ai/gateway/local-models

> OpenClaw를 무료로 써야겠다는분들

> 괜히 Local LLM설치하지 말고,

> 차라리 OpenRouter에서 고르세요🤔

> 일단 무료모델도 많고,

> 뭘 골라도 당신의 로컬보단 낫습니다🙅🏻♂️

https://www.threads.com/@byeongki_j/post/DULaWNpCYzC/

탈중앙화를 꿈꾸지만 아직은 이른가 보네요...

좋은 아티클이네요.

로컬 llm 제외하고나면 램 많은 옛날 놋북에서 돌려도 되는걸까요 (라이젠 2700u인데 20기가램이라던가)

만약 그렇다면 외부 llm에 사고를 부탁하는식으로 깡통 m1 맥미니 (8기가, 256기가)에 돌려도 되나요...?

오 글쿤요. 이하 기사보니 흥미가 좀 생기네요.

하나 또 배워갑니다

> OpenClaw를 무료로 써야겠다는분들

> 괜히 Local LLM설치하지 말고,

> 차라리 OpenRouter에서 고르세요🤔

> 일단 무료모델도 많고,

> 뭘 골라도 당신의 로컬보단 낫습니다🙅🏻♂️

글게요. 깡통 m1도 저전력이고... 특히 브라우저 미친듯이 띄워도 잘돌았었고...

조건은 팔라던 m1 맥미니 깡통이라도 괜찮을것 같네요.

아니면 20기가로 메모리만 우겨넣은 2700u 라이젠 놋북도 이런 일에는 맞을 듯도 싶네요

전 무료 llm모델이 있다니 흥미가 생기는데 이쪽으로도 한번 해보시지요

대학생이랑 이야기 하다가

뭔가 초딩이랑 이야기 하는 기분을 받습니다

분명 지피티는 스스로 해낸걸

로컬 llm 들은 못해내더라고요