blog: https://www.lgresearch.ai/blog/view?seq=506

GitHUB: https://github.com/LG-AI-EXAONE/EXAONE-3.5

HuggingFace: https://huggingface.co/collections/LGAI-EXAONE/exaone-35-674d0e1bb3dcd2ab6f39dbb4

Technical Report (PDF): https://arxiv.org/abs/2412.04862

(그림 출처: LG AI연구원 공식 블로그)

12/9(월) EXAONE 3.5가 공개 되었습니다.

지난 3.0 발표에는 파라미터 수가 7.8B 모델 1개만 공개되었지만

이번에는 7.8B뿐만 아니라 2.4B, 32B도 같이 발표되었습니다.

그리고 큰 변화는 3.0에서는 토큰 길이가 4k이었으나

이번 3.5에서는 3개 모델 모두 32k으로 늘었습니다.

추가로 모델 파일 포맷도 양자화 모델인 AWQ, GGUF (ollama 지원)이 나와서

BF16 ~ Q4까지 다양한 양자 모델도 공개되었습니다.

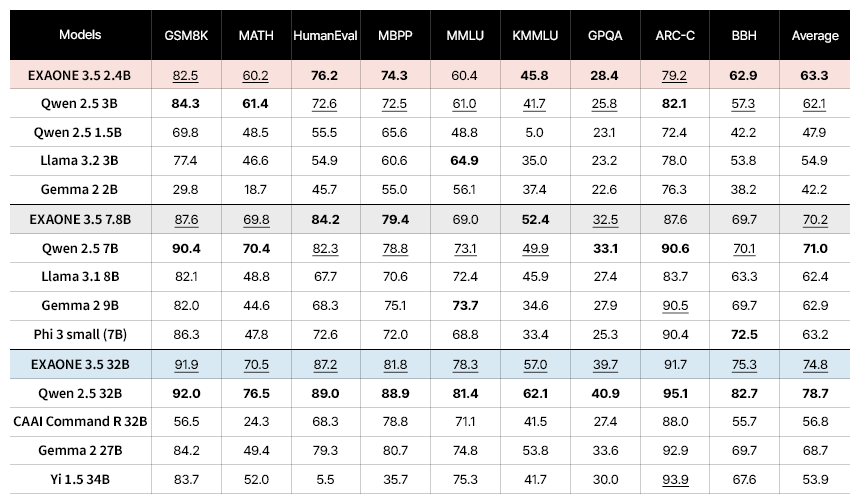

아래 벤치마크 표도 공개하였습니다

- 어디까지나 벤치마크는 수치일뿐, 실제 사용자 경험은 다를 수 있으므로 참고로만 보시면 좋을 듯 합니다.

- Llama는 기본적으로 한국어를 공식지원하지 않아서, 추가 학습/튜닝이 되어야 한글이 원활하게 작동되므로 그런 점에서는 처음부터 한글로 학습된 모델이 사용성이 좀 더 좋다고 생각합니다.

- 3.0 공개이후 빠르게 3.5으로 개선하고. 추가로 다양한 파라미터 모델을 공개한 점은 국내 AI 연구에도 좋은 자극이 되지 않을까 싶네요!

공개 버전 중에는 Qwen 이 가장 좋은 것으로 나오는군요. 문제는 이건 중국의 검열이 들어간 거라서...